Wahrscheinlichkeit

Aus MM*Stat

Grundbegriffe

Wahrscheinlichkeit

Die Wahrscheinlichkeit ist ein Maß zur Quantifizierung der Sicherheit bzw. Unsicherheit über das Eintreten von Ereignissen im Rahmen eines Zufallsexperimentes.

Im folgenden werden drei Wahrscheinlichkeitsbegriffe vorgestellt.

Klassischer Wahrscheinlichkeitsbegriff (nach Laplace)

Nach Laplace haben die Ereignisse von Zufallsexperimenten folgende Eigenschaften:

- die Anzahl der Elementarereignisse ist endlich,

- genau eines der möglichen Elementarereignisse tritt als Realisation des Zufallsexperimentes ein,

- jedes Elementarereignis hat die gleiche Wahrscheinlichkeit des Eintretens.

Die Wahrscheinlichkeit von ist nach dem klassischen Wahrscheinlichkeitsbegriff definiert als:

- mit , und .

Statistischer Wahrscheinlichkeitsbegriff (nach von Mises)

Hier betrachtet man die Wahrscheinlichkeit als den Wert, gegen den die relative Häufigkeit des Ereignisses bei

- unendlich vielen, unabhängigen Wiederholungen des Zufallsexperiments

- unter identischen Bedingungen

konvergiert.

Sei die absolute Häufigkeit des Auftretens von bei -maliger Wiederholung des Zufallsexperiments.

Dann ist die relative Häufigkeit von :

Die Wahrscheinlichkeit von ist nach dem statistischen Wahrscheinlichkeitsbegriff definiert als:

Wegen für alle , gilt .

Axiomatischer Wahrscheinlichkeitsbegriff (nach Kolmogorov)

Die Wahrscheinlichkeit von ist nach dem axiomatischen Wahrscheinlichkeitsbegriff definiert als:

Ein Wahrscheinlichkeitsmaß ist eine Abbildung, die jedem Ereignis eines Ereignisraumes (d.h. eines gegebenen Zufallsexperiments) eine Zahl zuordnet, und die folgenden Bedingungen (Eigenschaften, Axiome) erfüllt:

- Axiom 1 (Nichtnegativität und Begrenzung):

- Die Wahrscheinlichkeit des Ereignisses eines Zufallsexperiments ist eine eindeutig bestimmte, reelle, nichtnegative Zahl, die der Bedingung genügt

- Axiom 2 (Normierung)

- Bezeichnet man mit das Ereignis, das alle Elementarereignisse eines Zufallsexperiments enthält, dann ist das sichere Ereignis mit

- Axiom 3 (Additivität)

- Sind zwei Ereignisse und eines Zufallsexperiments disjunkt , so gilt

Zusatzinformationen

Folgerungen aus den Axiomen (nach Kolmogorov)

Es seien Ereignisse und ein Wahrscheinlichkeitsmaß zu einem gegebenen Zufallsexperiment.

Dann gelten folgende Regeln:

- wenn gilt, folgt

- Wenn gilt, folgt

- mit

Herleitung von Beziehungen aus den Wahrscheinlichkeitsaxiomen

- Regel 1

- Zu zeigen ist: Für gilt .

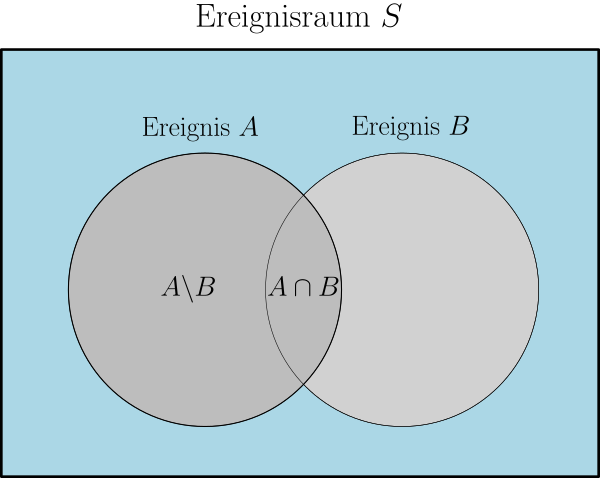

- Man kann das Ereignis schreiben als

- Dabei sind und disjunkt.

- Also gilt nach Axiom 3 .

- Wegen , muss gelten.

- Das folgende Venn-Diagramm veranschaulicht den Zusammenhang:

- Regel 2

- Zu zeigen ist: .

- Es gilt und weiter , wobei die Mengen der Vereinigung disjunkt sind.

- Also kann die Wahrscheinlichkeit für unter Berücksichtigung des Axioms 3 berechnet werden als

- Das folgende Venn-Diagramm veranschaulicht den Zusammenhang:

Beispiele

Klassische Wahrscheinlichkeit nach Laplace

Zufallsexperiment: Werfen eines idealen Würfels

| Ereignis: | = "gerade Augenzahl" |

| Elementarereignisse: | |

| in enthaltene Elementarereignisse | |

Statistische Wahrscheinlichkeit nach Mises

Zufallsexperiment: Werfen einer Münze

Sei das Ereignis "Kopf".

In der folgenden Tabelle ist die relative Häufigkeit des Eintretens von "Kopf" nach -maligem Werfen der Münze aufgezeichnet.

Sie nähert sich der Zahl , wenn sehr groß wird.

| 10 | 7 | 0,700 |

| 20 | 11 | 0,550 |

| 40 | 17 | 0,425 |

| 60 | 24 | 0,400 |

| 80 | 34 | 0,425 |

| 100 | 47 | 0,470 |

| 200 | 92 | 0,460 |

| 400 | 204 | 0,510 |

| 600 | 348 | 0,580 |

| 800 | 404 | 0,505 |

| 1 000 | 492 | 0,492 |

| 2 000 | 1 010 | 0,505 |

| 3 000 | 1 530 | 0,510 |

| 4 000 | 2 032 | 0,508 |

| 5 000 | 2 515 | 0,503 |

Die Konvergenz der relativen Häufigkeit wird noch deutlicher in einem Pfaddiagramm.

Im folgenden Diagramm bezeichnet die Abzisse die Anzahl der Würfe und die Ordinate .

| <R output="display">

pdf(rpdf, width=7, height=7) muenze = c(0.700,0.550,0.425,0.400,0.425,0.470,0.460,0.510,0.580,0.505,0.492,0.505,0.510,0.508,0.503) plot(muenze, type='l', col="black", lwd=4, ylab = "f(Kopf)", xlab = "Anzahl der W\u00FCrfe (n)", "xaxt"="n", ylim=c(0.3, 0.7), font=2, font.lab=2, "xaxs"="i" ,"yaxs"="i", bty="l") abline(h=0.5, lty=2, lwd=4, col="gray") axis(1, at = c(1:15), labels = c(10,"", 40, "", 80, "", 200, "", 600, "", 1000, "", 3000, "", 5000), font=2) </R> |

Dieses Beispiel verdeutlicht auch einen wichtigen Aspekt, der bei der Interpretation zu beachten ist:

Mit der relativen Häufigkeit wird eine Aussage bezüglich des Auftretens des Ereignisses bei bereits durchgeführten Versuchen, d.h. nach Versuchsdurchführung, getroffen.

Mit der Wahrscheinlichkeit des Ereignisses wird jedoch eine Aussage über das Eintreten des Ereignisses vor der Versuchsdurchführung gemacht.

Weiterhin kann ein Zufallsexperiment in der Realität nicht unendlich oft wiederholt werden.

Die Relevanz der statistischen Definition der Wahrscheinlichkeit ergibt sich daraus, dass mit der relativen Häufigkeit eine Approximation an die dem Zufallsexperiment zugrunde liegende (unbekannte) Wahrscheinlichkeit gegeben ist.